Nástroje generativní umělé inteligence (GenAI) představují revoluci v podnikových operacích a nabízejí možnost rychle zvýšit efektivitu a řešit složité problémy. Tento ohromný potenciál však přichází s dost podstatnou výzvou v podobě ochrany osobních údajů – což je obzvlášť patrné při nasazení AI v zákaznické podpoře.

V březnu jeden nejmenovaný korejský konglomerát zrušil zákaz používání GenAI, aby jej o několik týdnů později znovu zavedl – zaměstnanci sdíleli citlivé interní informace, včetně proprietárního kódu a záznamů schůzek. Tento incident ukazuje, že zatímco se organizace snaží využít AI ke zvýšení produktivity, musejí současně kontrolovat rizika úniku dat.

Aby předešla podobným situacím a zároveň naplno využila pokročilé technologie umělé inteligence, implementovala společnost Synology komplexní techniky deidentifikace a pečlivé ochranné metody do svých procesů – zejména pak zákaznické podpory. To zajišťuje odpovědné zacházení s informacemi o zákaznících a dodržuje vysoké standardy bezpečnosti dat a soukromí.

Provádění deidentifikace v souladu s GDPR

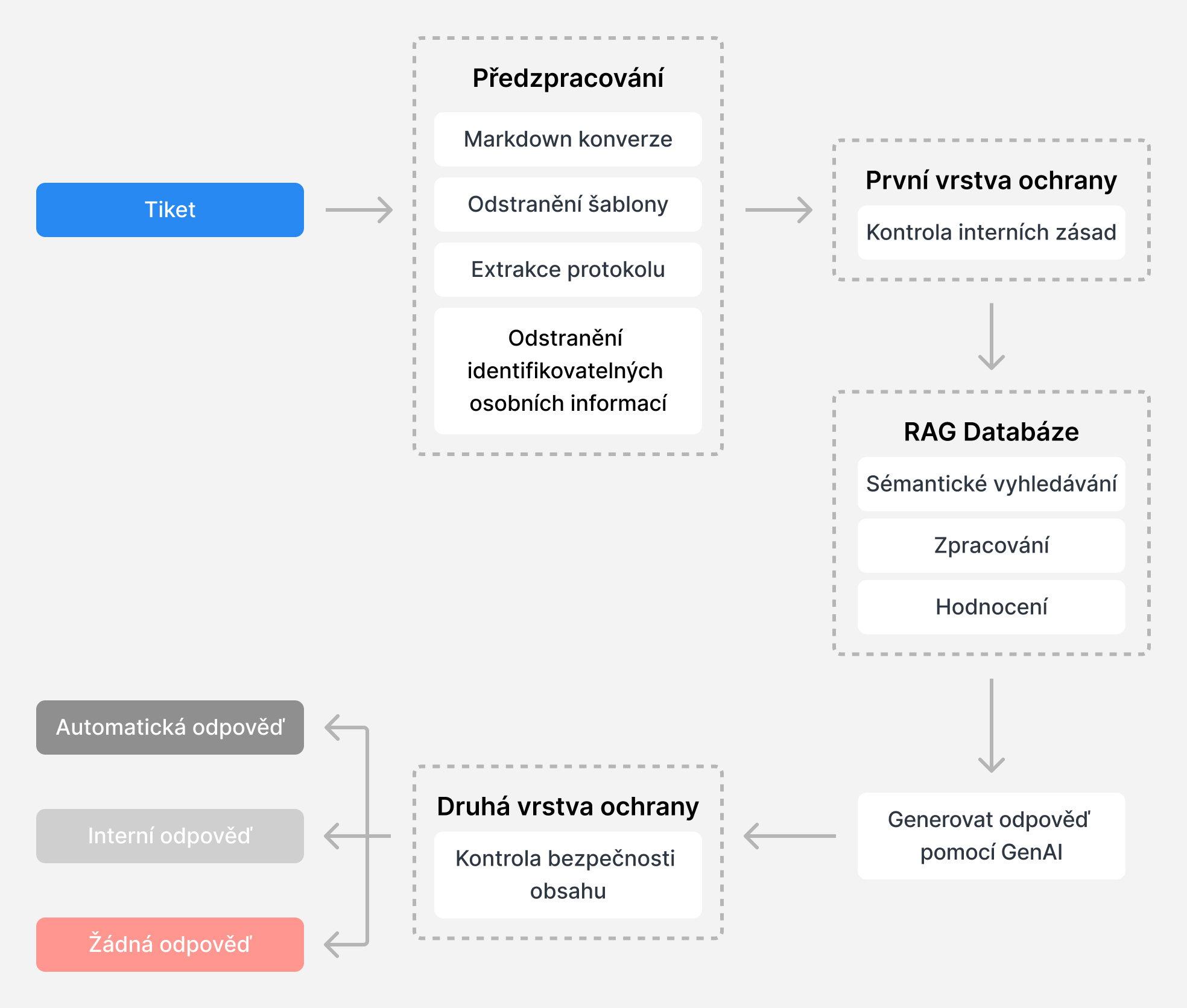

V Synology jsme vyvinuli systém Retrieval-Augmented Generation (RAG), který zvyšuje efektivitu a přesnost technické podpory. Vytvořili jsme také databázi akreditovaných případů podpory z loňského roku. Ta poskytuje aktuální informace specifické pro produkty a řešení Synology schválená profesionálními inženýry technické podpory.

Když přijmeme nový požadavek, systém RAG analyzuje zákazníkův dotaz a získá relevantní řešení z databáze. Tím docílíme vyšší kvality odpovědí ve srovnání s odpověďmi generovanými GenAI (trénovanými na veřejných datech).

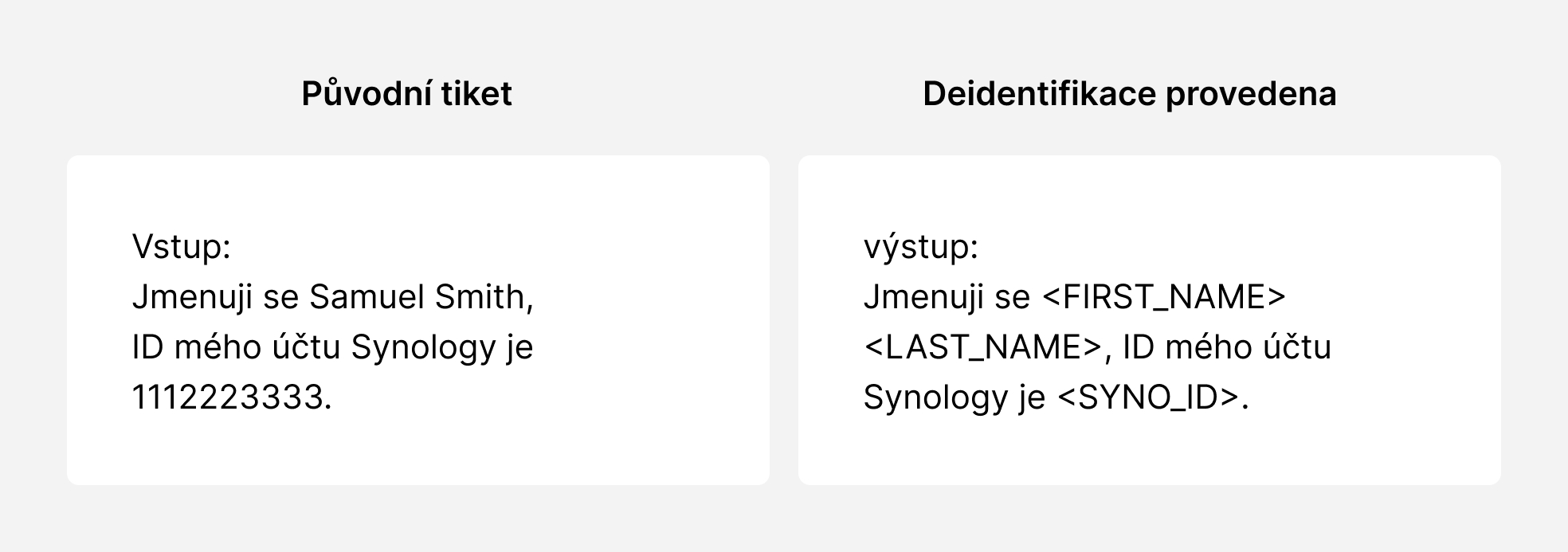

Tento systém spočívá na základech ochrany soukromí zákazníků s komplexním mechanismem deidentifikace. Ten zajišťuje, že všechna data z minulých případů a nově přijatých tiketů jsou před použitím anonymizována:

-

Regex Identification: regulární výrazy (Regex) identifikují vzorce, jako jsou e-maily a telefonní čísla na tiketech podpory.

-

Rozpoznávání pojmenovaných entit (NER): zpracování přirozeného jazyka k detekci entit na základě porozumění kontextu.

-

Ověření kontrolního součtu (checksum): zajišťuje přesnost těchto vzorců.

-

Kontextová analýza: analyzuje okolní text pro zvýšení spolehlivosti detekce.

-

Anonymizační techniky: zabezpečují zjištěné citlivé informace.

A co je nejdůležitější, tento komplexní proces deidentifikace se provádí v prostředí, které je v souladu GDPR. Tím je zajištěna úplná shoda s předpisy a anonymizace dat.

Zabraňte škodlivým, zkresleným nebo jinak nežádoucím výstupům pomocí ochranných mantinelů (guardrails)

Po opětovném zpracování za účelem deidentifikace procházejí všechny odpovědi generované umělou inteligencí dvěma vrstvami zabezpečení v systému pro kontrolu zásad. To zabraňuje jakémukoli neúmyslnému odhalení citlivých informací nebo potenciálně škodlivých rad.

-

Kontrola interních zásad: první ochranný mechanismus kontroluje porušení interních zásad nebo jakákoli rizika ztráty dat pro uživatele. Pokud například tiket vyžaduje instalační soubory, DSM nebo verze aplikace, které by mohly ovlivnit stávající prostředí uživatelů, pomoc s běžnými zranitelnostmi a problémy (CVE) nebo odkazuje na jiné tikety podpory, systém přestane reagovat. Namísto toho pošle pracovníkovi technické podpory souhrn hlavních faktorů, které mu pomohou v rozhodnutí o dalším postupu.

-

Kontrola bezpečnosti obsahu: druhá vrstva ochrany zajišťuje, že generované odpovědi neposkytují citlivé informace, jako jsou příkazy konzole, podrobnosti o vzdáleném přístupu nebo jiná kontextově přesná data. Po dokončení tohoto ochranného procesu se systém nakonec rozhodne, zda odpoví automaticky, nebo předá tiket pracovníkům podpory ke kontrole.

Závěr: využití AI v zákaznické podpoře nesmí být na úkor ochrany soukromí

Tento automatizovaný pracovní postup podpory poháněný umělou inteligencí výrazně zvýšil přesnost a relevanci odezvy a dvacetkrát zkrátil naši reakční dobu. Zavedením přísných procesů deidentifikace a robustních ochranných opatření zajišťujeme důvěrnost dat a dodržujeme přísné protokoly o ochraně osobních údajů.

Díky našim zkušenostem s vývojem systému zákaznické podpory založené na umělé inteligenci jsme si plně uvědomili, že ačkoli má umělá inteligence výkonné možnosti řešení problémů, musí být důkladně omezena kontrolními mechanismy. Tím zajištujeme rovnováhu mezi efektivitou a soukromím. Do budoucna tak bude společnost Synology nadále dodržovat své závazky týkající se ochrany soukromí – využijeme naplno potenciál umělé inteligence a zároveň zachováme maximální ochranu cenných dat zákazníků.

Autor: Steven Liang, Manager of Generative AI Application, Synology